Beiträge aus verschiedenen Themenbereichen

Information, Informationsreduktion

Korrekte Information soll sagen, was ist - am besten in allen Details. Leider ist das nicht erreichbar. Denn das Objekt der Betrachtung, über das die Information etwas aussagen soll, ist nicht die Information, sondern das Objekt. Wenn die Information alle Details des Objekt enthalten sollte, müsste sie eine Kopie des Objekts sein. Wenn jemand alle

Entropie, Zeit

Entropie ist Alltag Der Begriff Entropie gilt als nerdig, doch Entropie ist ein ganz alltägliches Phänomen. Wir kennen es alle bestens: - Ist Ihre Küche einigermassen aufgeräumt und sauber? - Haben Sie Ihre Zähne geputzt? - Haben die Socken an ihren Füssen die gleiche Farbe? Wenn Sie eine dieser Frage mit Ja beantworten, beschäftigen Sie

Dimensionen / Kontext, Information, Uncategorized

Loops sind überall Wo immer Informationsflüsse vorkommen, spielen sie eine unverzichtbare Rolle. Physik, Biologie und Psychologie sind ohne Loops undenkbar. Das Problem dabei ist: Loops sind heikel bezüglich Logik. Loops tendieren dazu, Algorithmen und Absichten zu zerstören. Loops (Schleifen) sind andererseits ausserordentlich interessant bei der Beschreibung von komplexen Situationen, z.B. bei der Analyse von Denkvorgängen

Entropie, Information, Informationsreduktion

Wollen wir möglichst wenig wissen? Natürlich nicht, je mehr wir wissen, umso besser, werden Sie denken. Doch so ganz möchte ich Ihnen nicht zustimmen. Es gibt Details, die mich nicht interessieren und in meinem Kopf ist nicht unbeschränkt Platz. Also muss ich haushalten. Dazu ist eine Reduktion der verfügbaren Informationsmenge hilfreich. Je kleiner sie ist,

Dimensionen / Kontext, Information

Effizienz oder Details? Das Dilemma Die Informationsökonomie ist eine Herausforderung für die Informationsverarbeitung. Je mehr Informationen ich zur Hand habe, umso präziser wird mein System. Je mehr Informationen ich aber berücksichtigen muss, umso langsamer wird mein System auch. In diesem Dilemma befinden wir uns immer. Wir können natürlich Rechenkapazität und die Speichermöglichkeit unserer Systeme hochschrauben, und

Information, Musik, Semantik

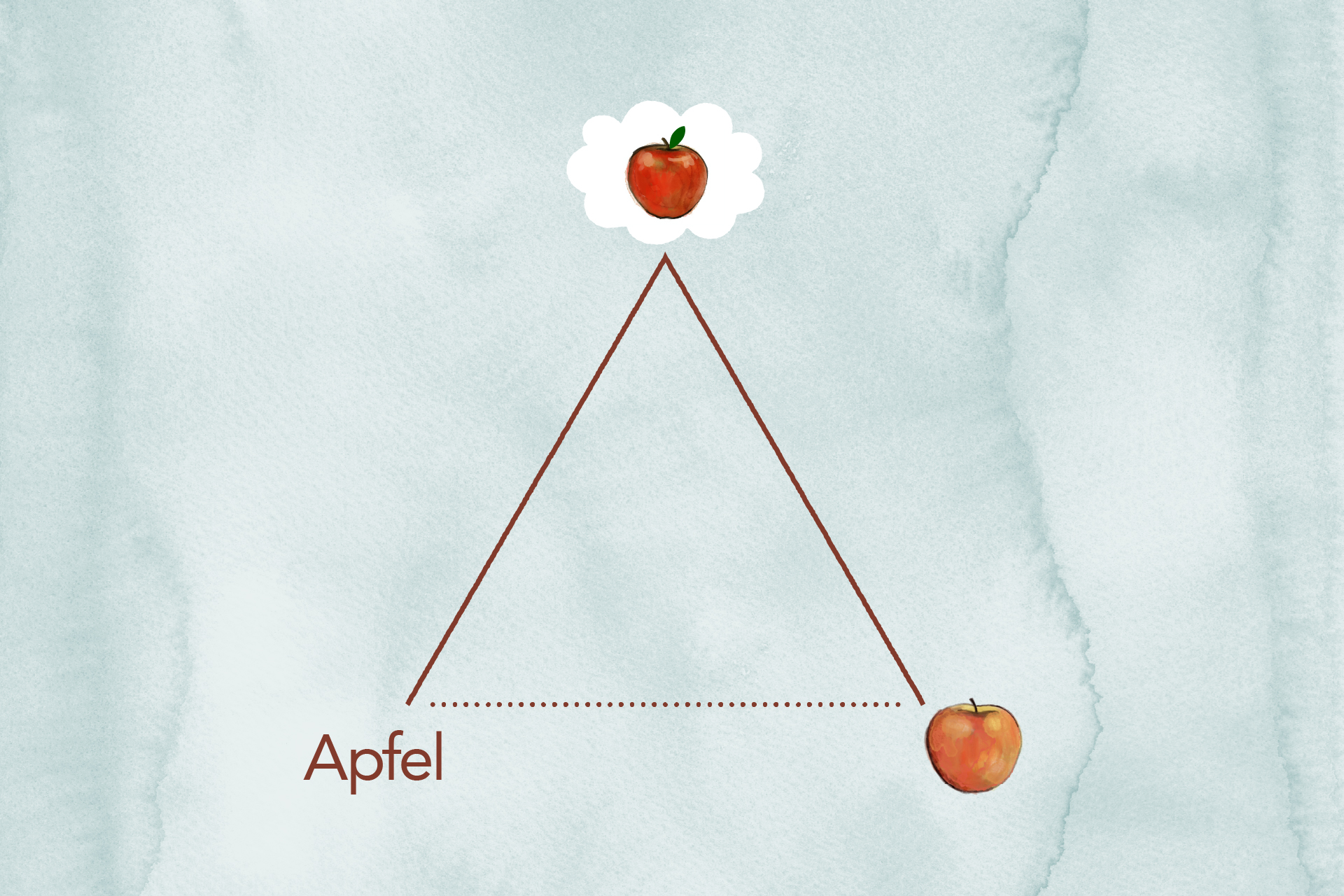

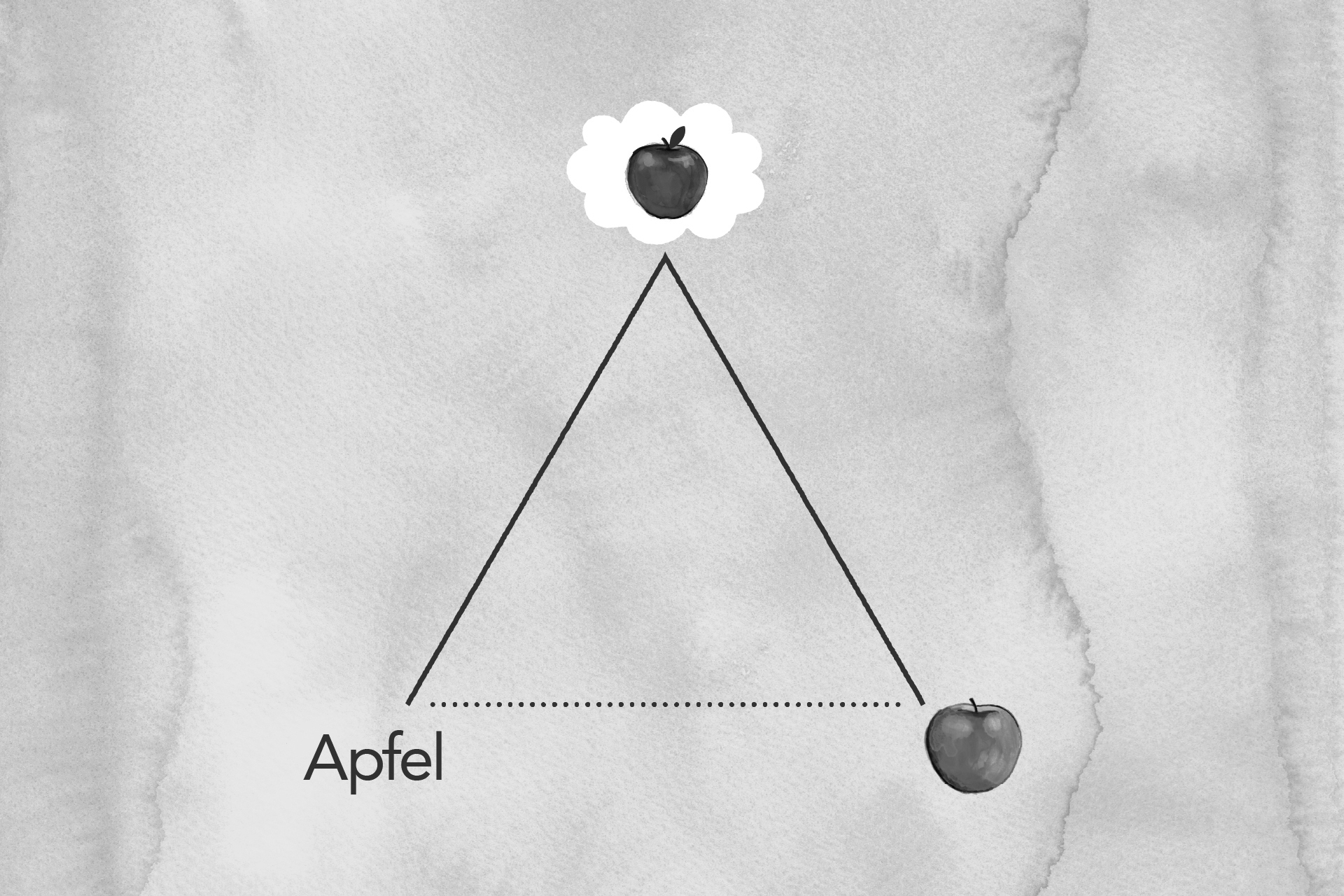

Wörter sind mehrdeutig Wenn wir sprechen, verwenden wir Wörter, um die Gegenstände unserer Umgebung zu bezeichnen. Mit den Wörtern besitzen wir die Gegenstände aber nicht, sondern bezeichnen sie nur, und wie wir alle wissen, sind Wörter nicht identisch mit den bezeichneten Gegenständen. Dass keine Identität besteht, ist offensichtlich. Beispiele für die nicht immer logische

Logik, Paradoxon, Selbstreferenzialität

Der Trick, mit dem sich klassische logische Systeme sprengen lassen, besteht aus zwei Anweisungen: 1: Eine Aussage beziehe sich auf sich selber. 2: In Bezug oder in der Aussage gibt es eine Verneinung. Durch diese Konstellation entsteht immer eine Paradoxie. Aber lassen Sie uns das Thema genauer betrachten…

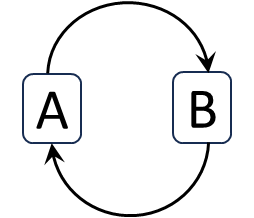

Information, Logik, Loops, Uncategorized

Loops gibt es nicht nur bei der Programmierung Jeder Programmierer hat schon Loops angetroffen, genauso wie jeder Verliebte und jeder Kriegsherr. Loops sind überall. Die einfachsten Loops haben die Form: If A ↝ Then B If B ↝ Then A oder visuell ausgedrückt: Was ein einfacher Loop bedeutet Diese Situation führt dazu, dass A und

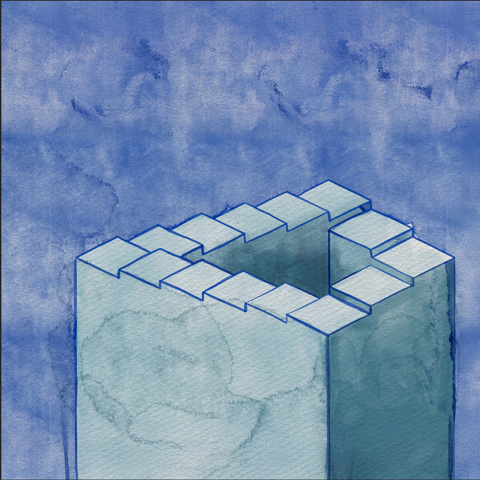

Entropie, Information, Mikro / Makro

Unter Energie kann sich jedermann etwas vorstellen, unter dem noch wichtigeren Begriff Entropie jedoch die wenigsten. Dabei spielt Entropie in der allgemeinen Physik, der Informationstheorie und der Biologie eine entscheidende Rolle. Und: Es gibt Gründe, weshalb der Begriff so schwierig zu verstehen ist. Das hat vor allem damit zu tun, dass Entropie physikalisch und informationstheoretisch als Abstand zwischen der Mikro- und Makroebene eines untersuchten Objekts definiert ist.

Bits, Information, Logik

Unsere Informationstechnologie baut auf dem Bit auf. Alles, was in unseren Computern geschieht, basiert auf diesem kleinsten Basiselement der Information. Wenn Sie gefragt werden, was ein einzelnes Bit bedeutet, werden Sie möglicherweise antworten, dass das Bit zwei Zustände einnehmen kann, von denen der eine 0 ist und der andere 1 bedeutet. Aber stimmt das auch? Bedeutet wirklich der eine Zustand im Bit 0 und der andere 1? Können die beiden Zustände nicht auch ganz andere Bedeutungen annehmen?

Drei-Welten-Theorie, Musik, Resonanz, Tonleitern

Die physikalische Basis der Resonanz Resonanz basiert auf den Eigenschwingungen von physikalischen Medien und ihrer gegenseitigen Koppelung. Koppelung der Eigenschwingungen von physikalischen Objekten Die Eigenschwingungen sind stehende Wellen, deren Frequenz von den Eigenschaften des physikalischen Mediums (Grösse, Form, Material, etc. ) bestimmt wird. Zwei solche Medien können über ihre Eigenschwingung in eine Resonanz treten. Die

Entropie, Information

Nerds interessieren sich gern für entlegene Themen. Da passt Entropie gut hinein, nicht wahr? Blutleere Nerds stellen sich damit als intellektuell überlegen dar. Dieses Spiel wollen Sie nicht mitmachen und Sie denken, dass es keinen wirklichen oder gar praktischen Grund gibt, sich mit Entropie zu beschäftigen. Diese Haltung ist sehr verbreitet und ziemlich falsch. Entropie ist kein nerdiges Thema, sondern bestimmt ganz grundlegend unser Leben, von der elementaren Physik bis in den praktischen Alltag hinein.

Entropie, Künstliche Intelligenz, Logik

Littering im Weltraum ist nicht erst seit Elon Musks Starlink-Programm ein Thema und aktuell werden verschiedene Methoden zur Reinigung des zunehmend vermüllten Weltraums rund um unserer Erde diskutiert. Die Aufgabe ist nicht einfach, weil - aufgrund des zweiten Hauptsatzes, nämlich der unausweichlichen Entropiezunahme - jede Vermüllung die Tendenz hat, exponentiell zuzunehmen.

Diverses, Drei-Welten-Theorie, Logik, Musik

Es gibt praktische Fragen, die mit unseren konkreten Leben zu tun haben, und theoretische Fragen, die damit scheinbar nichts zu tun haben. Es gibt aber auch theoretische Überlegungen, die durchaus mit unserem praktischen Alltag zu tun haben. Eine davon ist die Drei-Welten-Theorie, die sich damit beschäftigt, in welchen Welten wir konkret leben. Auf welchem Grund

Weiteres, Aktuelles & Wissenswertes

Persönlich

Informationen zu Hans Rudolf Straub

Aktuell beschäftige ich mich mit der Weiterenticklung von nicht-klassischer, dynamischer Logik sowie den Themenschwerpunkten Information, Semantik, Entropie und Musik. Mit einem kleinen, aber hochkarätigen Team entwickeln wir aktuell LD Cards, ein Programm zur Visualisierung und Kommunikation von Gedanken und Diskussionsverläufen bei komplexen Fragen.

Bücher

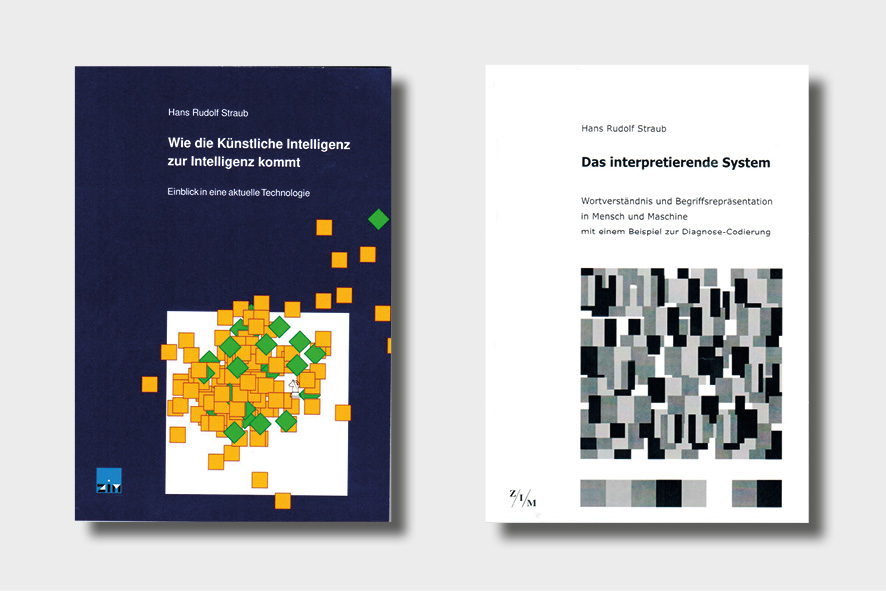

«Künstliche Intelligenz» und «Das interpretierende System»

Das Buch «Wie die Künstliche Intelligenz zur Intelligenz kommt» erschien bereits 2021 (in Deutsch) und ist heute vielleicht wichtiger denn je. Das Buch erklärt verständlich, was jedermann über KI wissen sollte: Was kann KI und was nicht? Welche Formen gibt es und wie funktioniert das?

Das Buch «Das interpretierende System» widmet sich der Semantik: Wie funktioniert Semantik – in Mensch und Maschine. Philosophische und technische Aspekte des Interpretationsvorganges werden mit gleicher Klarheit beleuchtet. Das Buch ist auf Deutsch und Englisch erhältlich.

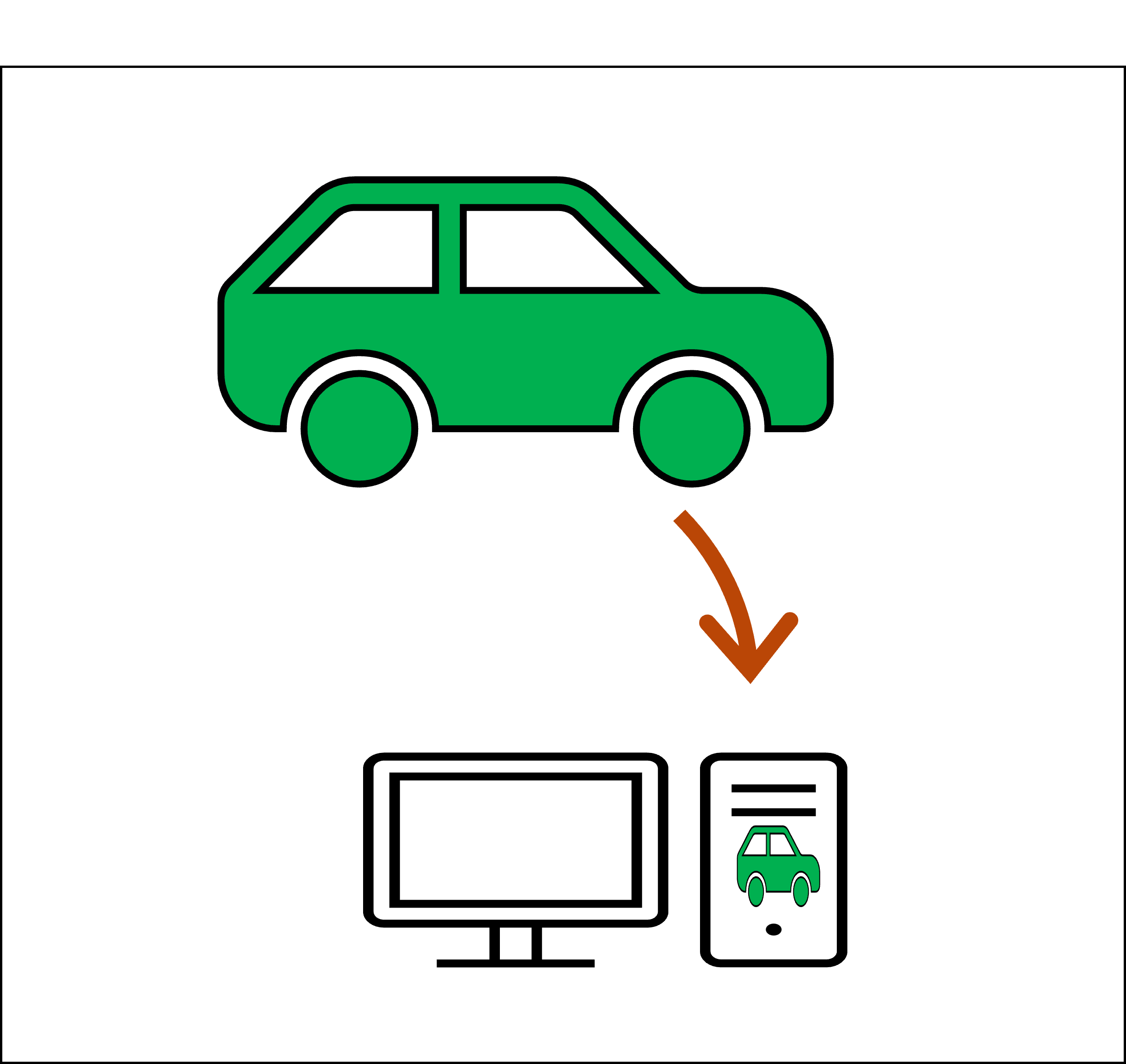

Personal Knowledge Manager

LD Cards – ein neuartiges Wissenstool für kreative Individuen

Logodynamics AG ist ein von Hansruedi Straub gegründetes Software-Start-up im Bereich Personal Knowledge Management (PKM) und bietet mit den «LD Cards» ein neuartiges Wissenstool für kreative Individuen und ambitionierte Wissensarbeiter. So kombinieren LD Cards u.a. intelligent die Funktionen eines visuellen Zettelkastens und eines leistungsfähigen Texteditors mit Multiuser-Funktionen und Logikdarstellungen (sog. «Views»).