Wie gefährlich ist Künstliche Intelligenz?

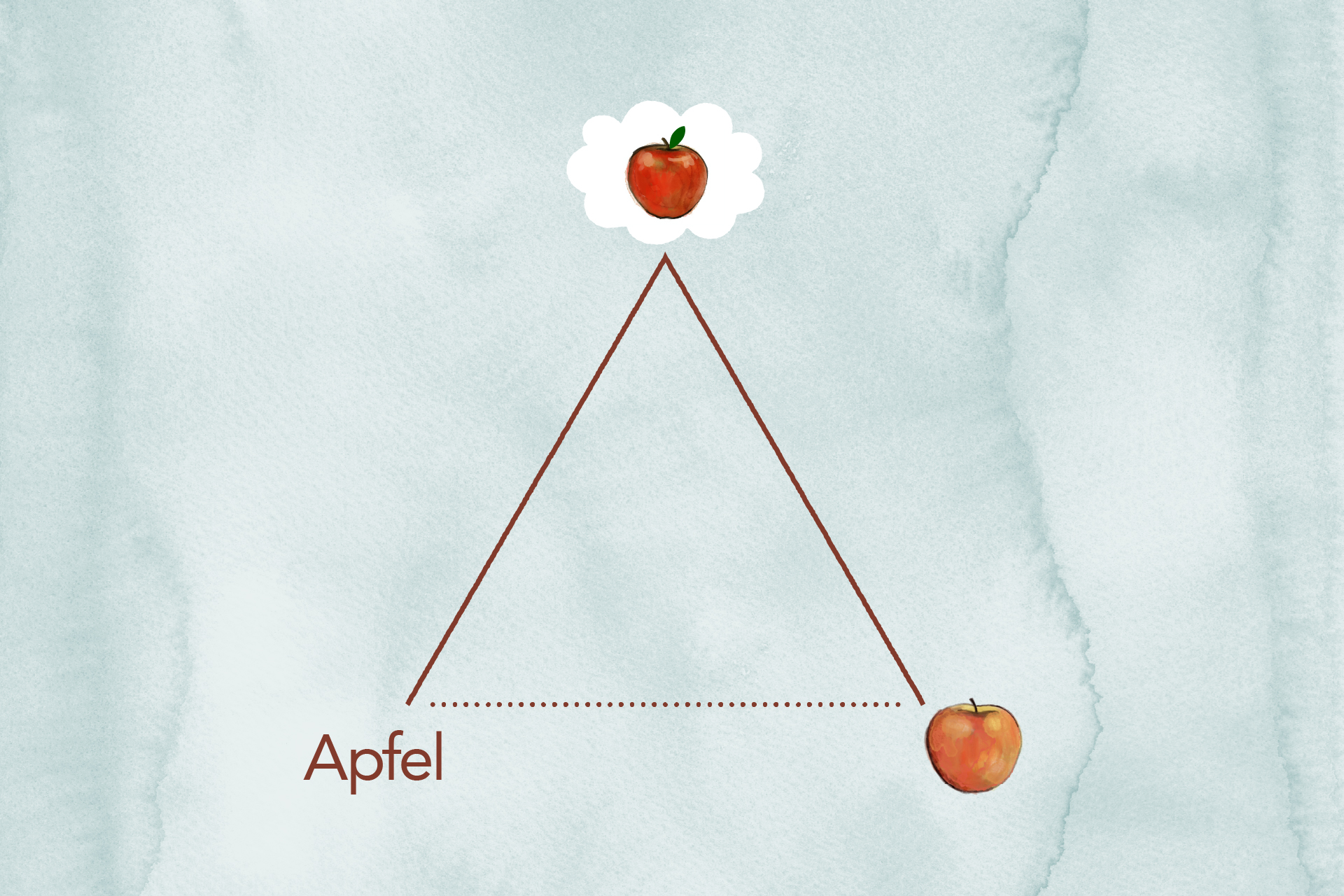

Was ist Intelligenz? Wenn heute über Nutzen und Gefahren der KI diskutiert wird, sollte dies nicht getan werden, ohne auf den Unterschied zwischen künstlicher und natürlicher Intelligenz hinzuweisen. Der Unterschied ist bei genauem Hinsehen evident, doch auf den ersten Blick kaum zu erkennen. Das ist die Gefahr, denn das Potenzial der künstlichen Intelligenz ist riesig. Das Dumme ist nur, dass KI zwar beeindruckend, aber nicht wirklich intelligent ist. Der Ausdruck KI, kommt aus dem Amerikanischen (artificial Intelligence), und dort hat das Wort intelligence zwei Bedeutungen: 1) Intelligenz (wie im Deutschen) 2) Erkennung, Aufklärung (wie in CIA) Die KI erscheint uns

Die Schwächen der Künstlichen Intelligenz (KI)

Die Datenverabeitungs-Methode der Neuronalen Netze - allgemein und fälschlicherweise als KI, also als "Künstliche Intelligenz" bezeichnet - ist erstaunlich leistungsfähig, wenn sie richtig eingesetzt wird. Manche fürchten sie und schreiben ihr einen eigenen Willen zu. Denn die KI eignet sich perfekt, um bei dafür empfänglichen Menschen Ängste vor einer mächtigen und undurchschaubaren Intelligenz auszulösen. Diese Ängste werden von der Unterhaltungsindustrie seit vielen Jahren bedient, um uns einen grusligen Kitzel zu verschaffen. In der Realität sehen die Gefahren allerdings ganz anders aus. Die Neuronalen Netze (NN) sind mächtig, leiden aber unter bemerkenswerten Schwächen. Diese Schwächen sind für Laien nicht auf den

Ijon Tichy trifft die künstliche Intelligenz

Littering im Weltraum ist nicht erst seit Elon Musks Starlink-Programm ein Thema und aktuell werden verschiedene Methoden zur Reinigung des zunehmend vermüllten Weltraums rund um unserer Erde diskutiert. Die Aufgabe ist nicht einfach, weil - aufgrund des zweiten Hauptsatzes, nämlich der unausweichlichen Entropiezunahme - jede Vermüllung die Tendenz hat, exponentiell zuzunehmen.

Hat der Chatbot LaMDA ein Bewusstsein?

Die Diskussion um künstliche Intelligenz bleibt aktuell, nicht zuletzt dank den Erfolgen von Google in diesem Bereich. Aktuell ist die Diskussion um LaMDA, eine KI, die genau darauf trainiert wurde, Dialoge so zu führen als wäre sie ein echter Mensch. Offenbar so überzeugend, dass der Google-Mitarbeiter Blake Lemoine selbst anfing, ihr ein eigenes Bewusstsein zuzugestehen und sogar erwägt haben soll, einen Anwalt für ihre Rechte als Person zu engagieren. Zu LaMDA und Lemoine, siehe z.B. https://www.derstandard.at/story/2000136501277/streit-bei-google-um-eine-ki-die-ein-eigenes-bewusstsein Doch nicht alle Beobachter stimmen mit Lemoine überein. Frau Sarah Spiekermann von der Wirtschaftsuniversität Wien sagt im Interview mit Radio SRF vom 23.6.22: "Da

Drei Beobachtungen zur Künstlichen Intelligenz / 3

Was hat die biologische der künstlichen Intelligenz voraus? Das Unwahrscheinliche einbeziehen Neuronale Netze bewerten die Wahrscheinlichkeit eines Ergebnisses. Dies entspricht einem sehr flachen Denkvorgang, denn nicht nur das Wahrscheinliche ist möglich. Gerade eine unwahrscheinliche Wendung kann ganz neue Perspektiven öffnen, im Leben wie im Denken. Das automatische Vorgehen der neuronalen Netze aber ist ein Denkkorsett, das stets das Wahrscheinliche erzwingt. Detaillierter differenzieren Neuronale Netze werden umso unpräziser, je mehr Details sie unterscheiden sollen. Schon mit wenigen Resultatmöglichkeiten (Outcomes) sind sie überfordert. Biologische Intelligenz hingegen kann sich je nach Fragestellung in sehr differenzierte Ergebniswelten eindenken, mit einer Vielfalt von Ergebnismöglichkeiten. Transparenz

Drei Beobachtungen zur Künstlichen Intelligenz / 2

Die Möglichkeiten der neuronalen Netze sind beschränkt Der unbezweifelbare Erfolg der neuronalen Netze lässt ihre Schwächen in den Hintergrund treten. Als korpusbasierte Systeme sind neuronale Netze völlig von der vorgängig erfolgten Datensammlung, dem Korpus abhängig. Prinzipiell kann nur die Information, die auch im Korpus steckt, vom neuronalen Netz überhaupt gesehen werden. Zudem muss der Korpus bewertet werden, was durch menschliche Experten erfolgt. Was nicht im Korpus steckt, befindet sich ausserhalb des Horizonts des neuronalen Netzes. Fehler im Korpus oder in seiner Bewertung führen zu Fehlern im neuronalen Netz: Intransparenz Welche Datensätze im Korpus zu welchen Schlüssen im neuronalen Netz führen,

Drei Beobachtungen zur Künstlichen Intelligenz / 1

KI umfasst mehr als nur neuronale Netze Neuronale Netze sind potent Was unter Künstlicher Intelligenz (KI) allgemein verstanden wird, sind sogenannte Neuronale Netze. Neuronale Netze sind potent und für ihre Anwendungsgebiete unschlagbar. Sie erweitern die technischen Möglichkeiten unserer Zivilisation massgeblich auf vielen Gebieten. Trotzdem sind neuronale Netze nur eine Möglichkeit, 'intelligente' Computerprogramme zu organisieren. Korpus- oder regelbasiert? Neuronale Netze sind korpusbasiert, d. h. ihre Technik basiert auf einer Datensammlung, dem Korpus, der von aussen in einer Lernphase Datum für Datum bewertet wird. Das Programm erkennt anschliessend in der Bewertung der Daten selbständig gewisse Muster, die auch für bisher unbekannte Fälle

Wie die Künstliche Intelligenz zur Intelligenz kommt

Die Intelligenz der KI kommt nicht aus dem Nichts. Sie kommt von Menschen. Über welche Wege die Intelligenz in die künstliche Intelligenz kommt, beschreibe ich in diesem Buch. Es erklärt verständlich, was jedermann über KI wissen sollte: Was sie kann und was nicht. Was für Formen es gibt und wie sie sich unterscheiden. Und nicht zuletzt: Wie die Intelligenz wirklich in die KI-Anwendungen kommt. Das Buch zur Intelligenz Titel «Wie die Künstliche Intelligenz zur Intelligenz kommt» Autor: Hans Rudolf Straub Verlag: ZIM-Verlag, St. Gallen Ausgabe: August 2021 Preis: CHF/Euro 19.- Weitere Angaben zum Buch finden Sie auf der Internetseite des Verlags.

Aktuelle Pressetexte zur Künstlichen Intelligenz

Meine These, dass sogenannte KI-Programme zwar ausserordentlich leistungsfähig sind, doch ihre Intelligenz bestenfalls geborgt haben und zu eigenständigen Denkleistungen aus prinzipiellen Gründen nicht imstande sind, wird zunehmend auch von anderen Seiten unterstützt. Hier drei Publikationen mit dieser Stossrichtung: St. Galler Tagblatt, 3. August 2021, Christoph Bopp: "Dr. Frankenstein verwirrte die Künstliche Intelligenz": https://www.tagblatt.ch/leben/ki-uund-medizin-doktor-frankenstein-verwirrte-die-kuenstliche-intelligenz-ld.2169958 . The Gradient: 3. August 2021, Valid S. Saba: "Machine Learning Won't Solve Natual Language Understanding": https://thegradient.pub/machine-learning-wont-solve-the-natural-language-understanding-challenge/ . Neue Zürcher Zeitung, 17. August 2021, Adrian Lobe: "Man kann Algorithmen zu Kommunisten erziehen, aber sie können auch zu Rassisten werden, wenn sie in schlechte Gesellschaft geraten" https://www.nzz.ch/feuilleton/wie-die-black-box-lernt-bots-kann-man-zu-rassisten-machen-ld.1636315?ga=1&kid=nl165_2021-8-16&mktcid=nled&mktcval=165_2021- 08-17

Wie die künstliche Intelligenz zur Intelligenz kommt

Haben Sie sich schon gefragt, woher die Intelligenz in der künstlichen Intelligenz stammt? Die Künstliche Intelligenz, etwa in Suchmaschinen oder Programmen zur Gesichtserkennung ist ja nichts anderes als ein Computerprogramm, das vorgängig mit Daten gefüttert worden ist. Ein raffiniertes und komplexes Programm zwar, aber letztlich nichts als ein Automat, eine Maschine. Und diese Maschine verhält sich intelligent. Wie kann das sein? Nun, darauf gibt es durchaus eine Antwort. Ich habe basierend auf meiner Berufspraxis im Bereich des NLP (Natural Language Processings) und der automatisierten Zuweisung von medizinischen Codes (ICD, CHOP, OPS, SNOMED) zu Freitexten eine Serie von Blogbeiträgen auf dieser